LLM Sessions AI Discovery: Wie 2 Millionen KI-Interaktionen SEO, Sichtbarkeit und Content-Strategien neu definieren

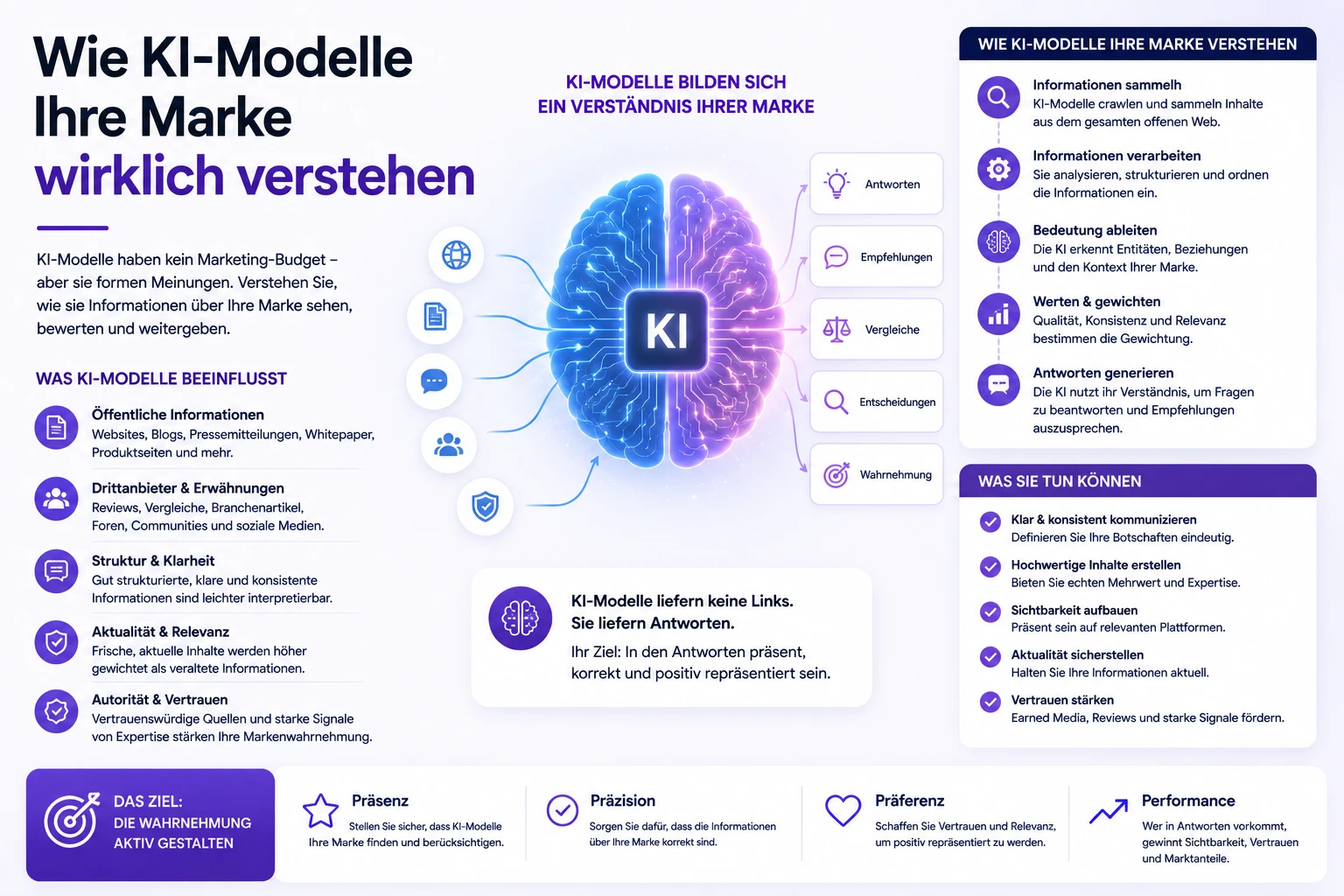

LLM Sessions AI Discovery beschreibt einen der tiefgreifendsten Umbrüche im digitalen Informationsverhalten seit Einführung moderner Suchmaschinen. Menschen treten in einen fortlaufenden Dialog mit KI-Systemen ein, um Informationen einzuordnen, zu bewerten und Entscheidungen vorzubereiten.

Inhalte konkurrieren nicht mehr nur um Rankings, sondern um Relevanz innerhalb eines mehrstufigen Entscheidungsprozesses. Dieser Beitrag basiert auf der Auswertung von über 2 Millionen realen LLM Sessions.

Executive Summary

- AI Discovery verschiebt Sichtbarkeit aus SERP-Listen in dialogische Entscheidungsprozesse.

- Content muss dialogfähig sein: konsistent über mehrere Gesprächsschritte nutzbar.

- Struktur gewinnt: Überschriften, Absätze, Listen und klare Einordnung erhöhen Zitation.

- Passage statt Seite: Ein starker Absatz kann sichtbarer sein als ein unstrukturierter Longform-Text.

- Governance wird Pflicht: Sichtbarkeit ist steuerbar, nicht dem Zufall überlassen.

Kurz erklärt: Die wichtigsten Begriffe

1) Was AI Discovery wirklich bedeutet

AI Discovery beschreibt eine veränderte Form der Informationsentdeckung. Nutzer erwarten nicht mehr eine Liste möglicher Antworten, sondern eine strukturierte Einordnung. KI-Systeme priorisieren Informationen, gewichten Argumente, verknüpfen Kontexte und leiten Handlungsmöglichkeiten ab.

Für Content-Strategien bedeutet das: Sichtbarkeit entsteht nicht mehr allein durch Auffindbarkeit, sondern durch Verwendbarkeit innerhalb eines Gesprächs.

2) LLM Sessions: Aufbau & Entscheidungslogik

Eine LLM Session ist kein einzelner Prompt. Sie ist ein mehrstufiger Entscheidungsdialog mit fünf typischen Phasen:

- Orientierung: „Was ist das?"

- Einordnung: „Wie funktioniert es?"

- Vergleich: „Welche Optionen gibt es?"

- Bewertung: „Was sind Vor- und Nachteile?"

- Handlung: „Was ist der nächste Schritt?"

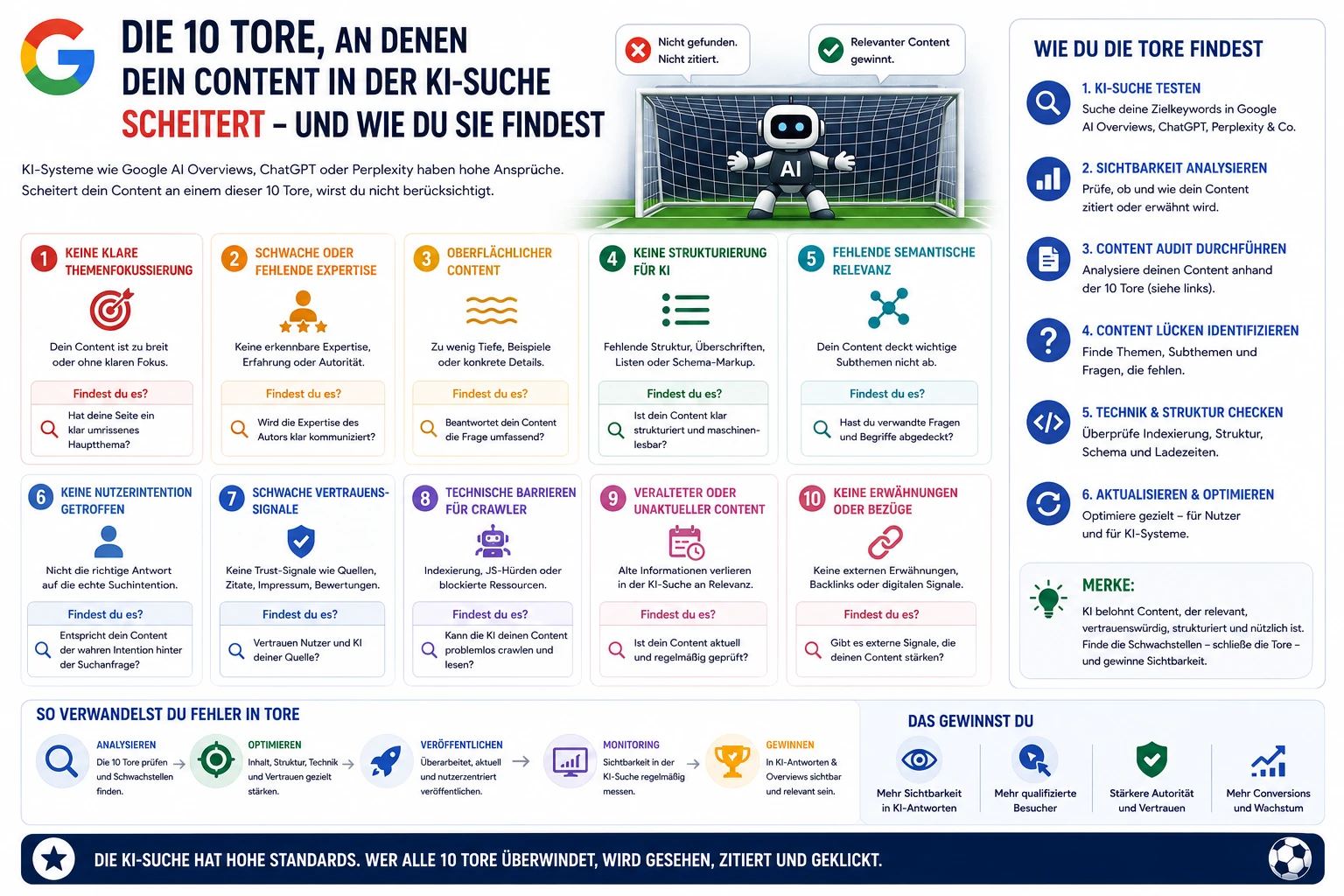

3) Warum klassische SEO strukturell an Grenzen stößt

Klassische SEO ist auf einzelne Suchanfragen optimiert. AI Discovery bewertet Inhalte entlang eines Gesprächsverlaufs. Rankings bleiben wichtig – verlieren aber ihre alleinige Steuerungsfunktion.

Deshalb erweitern wir SEO-Strategien bei YellowFrog SEO-Beratung um AI- und GEO-Dimensionen: Struktur, Zitationsfähigkeit, Konsistenz und Governance.

4) Die Datenbasis: 2 Millionen Sessions richtig gelesen

Die analysierten Sessions stammen aus SaaS, Finance, B2B-Services, E-Commerce und Publishing. Untersucht wurden vollständige Dialogverläufe – nicht nur einzelne Prompts.

- Fragen werden im Verlauf zunehmend präziser

- Kontext schlägt exakte Keywords

- Folgefragen entscheiden über Sichtbarkeit

- Strukturierte Inhalte werden bevorzugt zitiert

Daraus ergibt sich: Einzelartikel verlieren an Wirkung, konsistente Content-Cluster gewinnen. Genau so arbeiten wir in YellowFrog-Projekten.

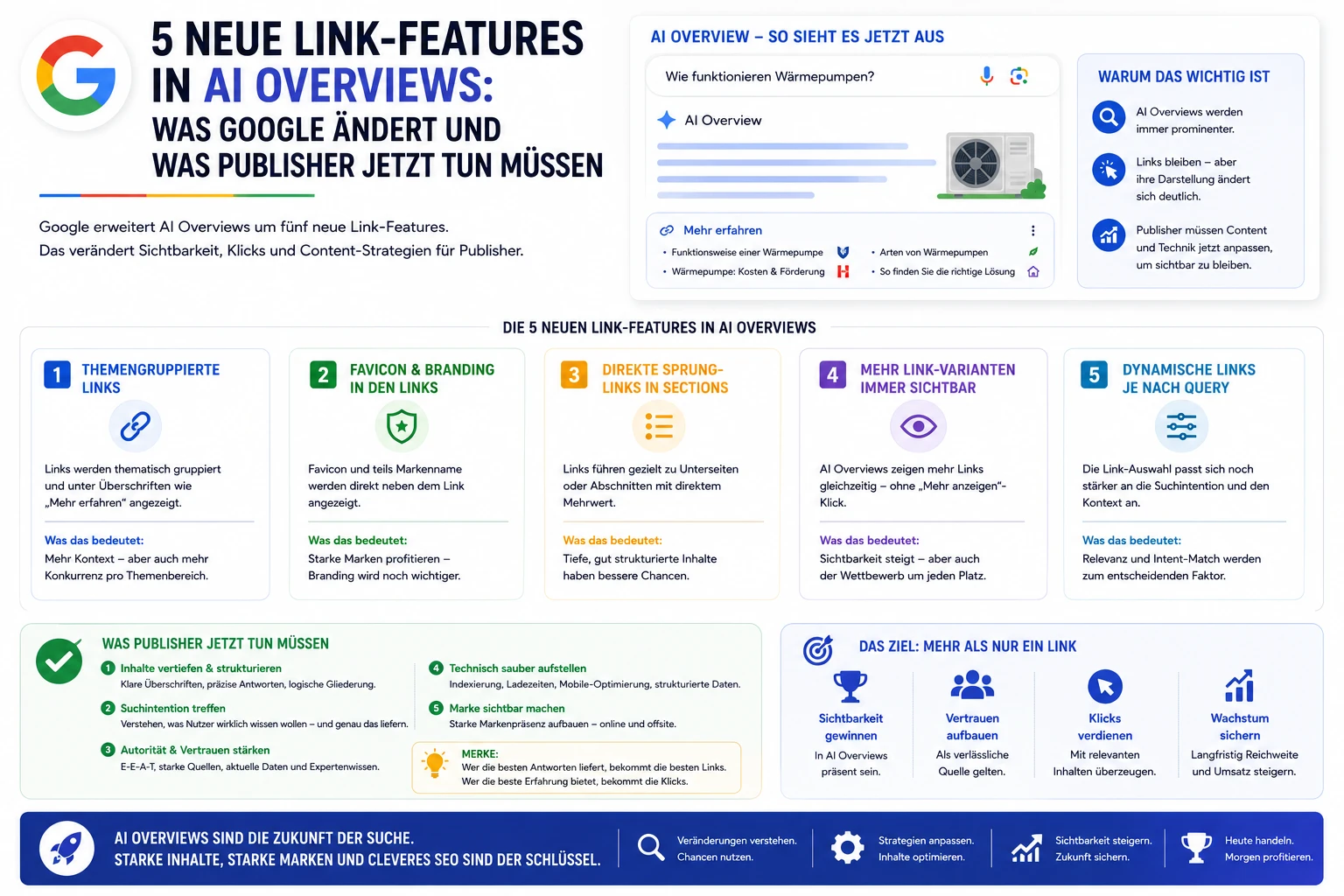

5) Plattformlogiken: ChatGPT, Copilot, Claude, Perplexity

AI Discovery ist kein einheitlicher Kanal. Jede Plattform erfüllt eine andere Rolle:

- ChatGPT: Einstieg für Orientierung und erste Einordnung.

- Microsoft Copilot: Discovery im Arbeitskontext – beeinflusst Entscheidungen in Produktivitätsflows.

- Claude: Tiefe Analysen, lange Dokumente, strategische Bewertungen.

- Perplexity: Gewinnt dort, wo Quellen-Transparenz entscheidend ist.

6) Wie LLMs Inhalte lesen: Chunking & Passage Extraction

LLMs lesen keine Webseiten am Stück. Sie zerlegen Inhalte in semantische Einheiten und nutzen daraus passende Passagen. Überschriften, Absätze, Listen und Definitionen werden einzeln bewertet und neu zusammengesetzt.

Tabelle: LLM-Session-Phasen & Content-Anforderungen

Wenn du AI Discovery gewinnen willst, musst du die Session-Logik bedienen – nicht nur den ersten Touchpoint.

| Session-Phase | Typische Nutzerfrage | Was KI braucht | Content-Baustein |

|---|---|---|---|

| Orientierung Start | „Was ist das?" | kurze Definition + Kontext | 1 Absatz + Glossar-Snippet |

| Einordnung Verständnis | „Wie funktioniert es?" | Schritte, Mechanik, Grenzen | Liste, How-it-works, Beispiele |

| Vergleich Optionen | „Welche Alternativen?" | Dimensionen + Kriterien | Vergleichstabelle, Pros/Cons |

| Bewertung Entscheidung | „Was ist besser – und warum?" | Argumentationskette, Trade-offs | Zwischenfazits, Entscheidungshilfe |

| Handlung Next Step | „Was mache ich jetzt?" | konkrete Schritte + Risiken | Checkliste + CTA/Plan |

7) LLM Reasoning: Wie KI Entscheidungen ableitet

Während Suchmaschinen Dokumente gegeneinander bewerten, konstruieren LLMs aus vielen Textfragmenten eine konsistente, logisch nachvollziehbare Antwort. Gefragt wird nicht: „Welche Seite ist die beste?" – sondern: „Welche Aussage passt logisch zur aktuellen Fragestellung und zum bisherigen Gesprächsverlauf?"

8) Passage Extraction: Warum einzelne Absätze wichtiger werden als ganze Seiten

Nicht die gesamte Seite wird bewertet, sondern einzelne Textabschnitte. Ein klar formulierter Abschnitt kann in AI-Antworten erscheinen, selbst wenn der restliche Content nicht genutzt wird. Jeder Absatz ist eine eigenständige Bedeutungseinheit.

- präzise definierte Absätze

- klar abgegrenzte Gedanken

- Zwischenfazits mit eindeutigen Aussagen

9) Copilot vs. ChatGPT vs. Claude: Warum Content unterschiedlich wirken muss

Inhalte werden in der Praxis für verschiedene Plattformen unterschiedlich relevant:

- ChatGPT: verständlich, ausgewogen, schnell konsumierbar (Orientierung).

- Copilot: handlungsorientiert (Empfehlungen, Risiken, nächste Schritte).

- Claude: tiefe Analyse, saubere Einordnung, lange Dokumentlogik.

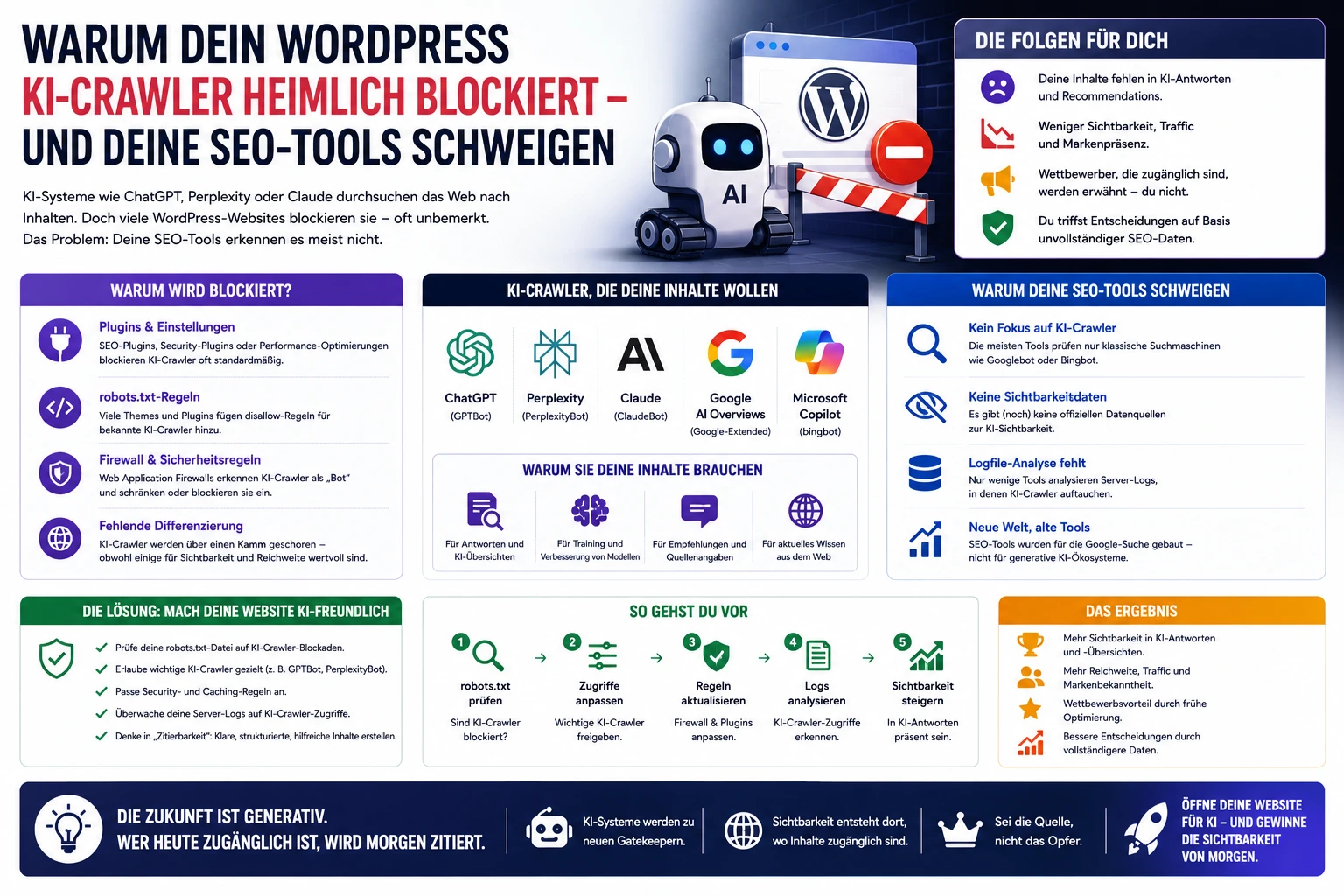

10) AI Governance: robots.txt, Bot-Steuerung & Verantwortung

Mit wachsender Bedeutung von AI Discovery wird Content-Governance strategisch. Unternehmen müssen aktiv entscheiden, welche Inhalte von KI-Systemen verarbeitet werden dürfen.

- Welche Inhalte sind sensibel oder vertraulich?

- Welche Aussagen sollen bewusst sichtbar sein?

- Welche Inhalte sollen nicht in KI-Kontexten auftauchen?

Technisch spielen robots.txt, Meta-Robots-Tags und spezifische KI-Bot-Regeln eine zunehmende Rolle.

11) Barrierefreiheit & semantisches HTML als AI-Signal

Barrierefreiheit ist nicht nur UX. Semantisch korrektes HTML hilft Screenreadern und KI-Systemen, Inhalte präzise zu interpretieren. Klare Überschriften, saubere Listen und eindeutige Absätze reduzieren Ambiguität – ein entscheidender Faktor für AI Discovery.

12) Praxis-Case: Wenn CTR sinkt, aber Sichtbarkeit steigt

In SEO-Audits beobachten wir zunehmend ein scheinbares Paradox: Rankings stabil, Impressionen steigen, CTR sinkt – gleichzeitig taucht die Marke häufiger in AI-Antworten auf.

Wer diese Signale falsch interpretiert, glaubt Sichtbarkeit zu verlieren. Tatsächlich verschiebt sich der Ort der Entscheidung vor den Klick.

Grafik: AI Discovery Flywheel (Orientierung → Bewertung → Handlung)

„Was ist das?"

„Was ist besser?"

„Was jetzt?"

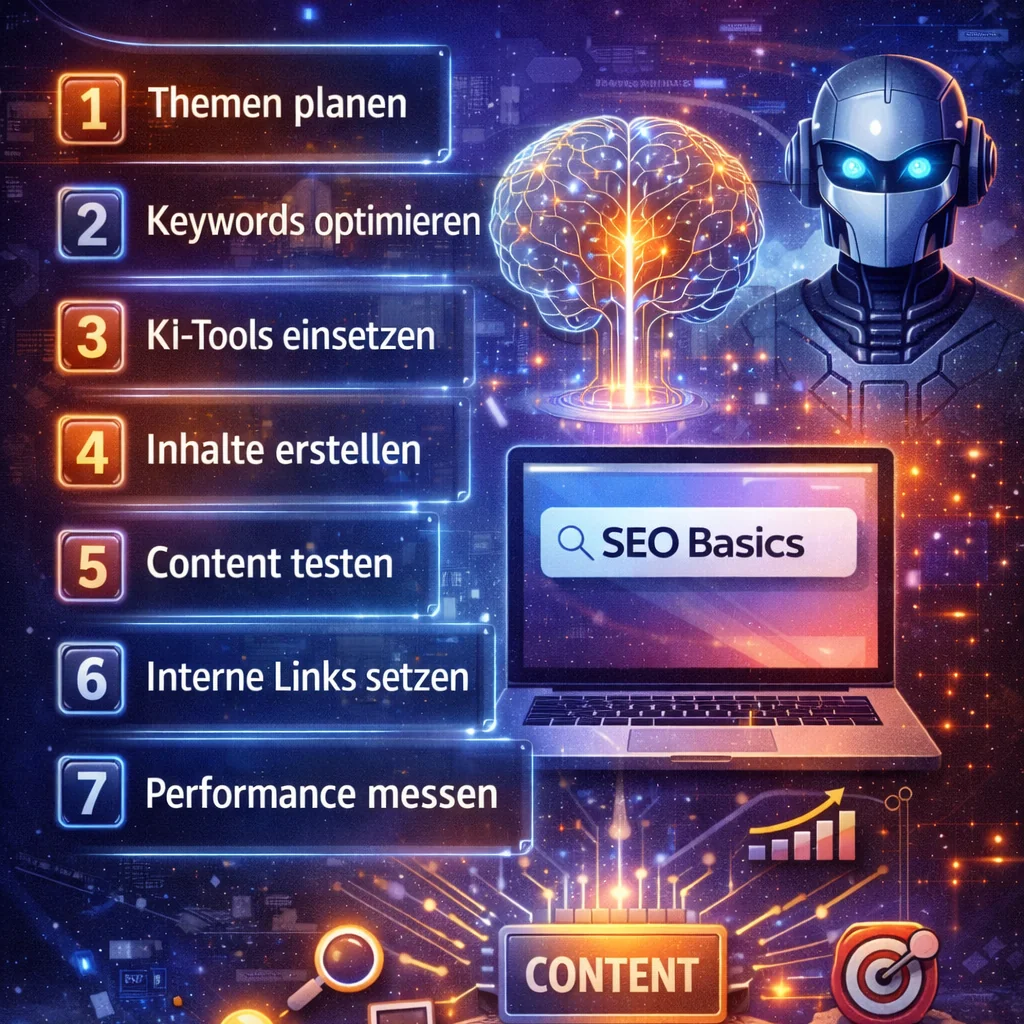

13) Handlungsempfehlungen für Content & SEO

Aus den Erkenntnissen lassen sich fünf konkrete Schritte ableiten:

FAQ – Häufige Fragen zu LLM Sessions & AI Discovery

Was sind LLM Sessions?

LLM Sessions sind mehrstufige Dialoge zwischen Nutzern und KI-Systemen. Sie bestehen aus aufeinander aufbauenden Fragen und Antworten, die gemeinsam zu einer Entscheidung führen.

Was bedeutet AI Discovery?

AI Discovery beschreibt die Entdeckung von Informationen direkt über KI-Systeme statt über klassische Suchergebnisseiten. Sichtbarkeit verlagert sich in dialogische Entscheidungsprozesse.

Ersetzt AI Discovery klassische SEO?

Nein. SEO bleibt die Grundlage für Auffindbarkeit. AI Discovery ist eine zusätzliche Ausspielungsebene, keine Ablösung.

Warum ist Struktur für KI so wichtig?

KI-Systeme zerlegen Inhalte in Abschnitte (Chunking). Klare Struktur erleichtert Interpretation und erhöht die Wahrscheinlichkeit, als Quelle zitiert zu werden.

Welche Inhalte werden häufiger in AI-Antworten genutzt?

Inhalte mit klaren Definitionen, Einordnungen und konkreten nächsten Schritten – plus konsistenten Aussagen über mehrere Abschnitte hinweg.

Warum sinkt oft die CTR bei stabilen Rankings?

Weil Nutzer Informationen bereits in AI-Antworten erhalten und Entscheidungen vor dem Klick treffen. Sinkende CTR kann ein Indikator für erfolgreiche AI-Sichtbarkeit sein.

Wie messe ich AI-Sichtbarkeit?

Über indirekte Signale: Brand Searches, stabile Rankings, bestimmte Query-Cluster in der Search Console und zeitverzögerte Conversions.

Welche Rolle spielt interne Verlinkung?

Interne Links helfen KI-Systemen, thematische Zusammenhänge und Content-Cluster zu erkennen – ein direktes Kontext-Signal für Passage Extraction.

Ist Barrierefreiheit ein Signal für KI?

Indirekt ja. Semantisch sauberes HTML erleichtert KI-Systemen das Verständnis und reduziert Interpretationsfehler bei Chunking und Passage Extraction.

Was ist der wichtigste erste Schritt?

Inhalte auf dialogische Logik prüfen: Sind sie klar strukturiert, passage-ready und bedienen sie alle Phasen einer LLM Session – Orientierung, Bewertung und Handlung?

.webp)

.webp)

.webp)